That Goodbye è una elaborazione del primo verso tratto dalla poesia “Do not go gently into that goodnight” di Dylan Thomas, letto dall’autore e tratto da una registrazione d’epoca.

L’idea di questo brano è di mettere a punto delle tecniche tali per cui la parola via via si “consumi” diventando lentamente puro suono.

Ora, una delle cose che mi hanno sempre affascinato è l’eco. Ma l’eco è una ripetizione (quasi) identica all’originale. In “That Goodbye” invece, ho adottato delle tecniche di elaborazione per cui l’eco ritorna modificato sempre di più ad ogni ripetizione.

Queste tecniche consistono nell’inserire il dispositivo di elaborazione all’interno del loop che genera l’eco. Quindi il suo effetto si accumula e cresce ad ogni ripetizione che così si trasforma sempre di più rispetto all’originale.

Questo modo di comporre è abbastanza lontano dalle tecniche tradizionali. Qui, io seleziono processi di elaborazione che generano risultati di lunga durata. La composizione, a questo punto, equivale alla scelta dei frammenti sonori e dei processi di elaborazione attraverso i quali devono ‘rotolare’.

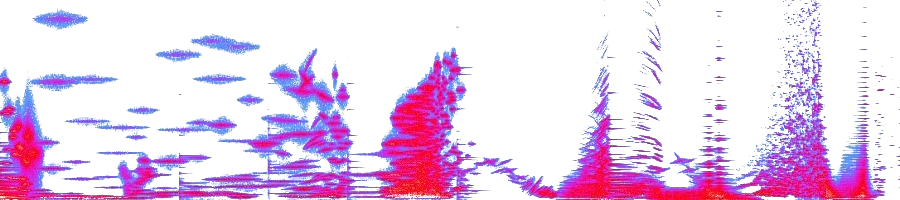

Alcuni esempi [NB: per non costringevi ad ascoltare mezz’ora di esempi, tutti gli eventi sono accelerati rispetto al loro utilizzo nel brano, nel senso che il delay è molto breve (circa 1 sec.) e quindi la frequenza delle ripetizioni è elevata per cui la trasformazione avviene nel giro di pochi secondi].

- Elemento di elaborazione: riverbero

In questo esempio l’accumulo della riverberazione a ogni ciclo di loop produce un alone sempre più lungo e presente per cui il riverbero si “mangia” letteralmente il suono riducendolo alle sole frequenze di risonanza eccitate dall’input. Il collegamento con in frammento iniziale rimane in forma agogica. Sotto l’aspetto frequenziale, il risultato dipende sia dalle frequenze presenti nell’input che dalle frequenze di risonanza del riverbero.

- Elemento di elaborazione: filtro

Ad ogni ciclo di loop l’input è filtrato con un passa-banda a guadagno unitario, che lascia inalterata solo la freq. di centro-banda e attenua tutte le altre. Il suono, via via, si semplifica fino a lasciare una singola sinusoide.

- Elemento di elaborazione: flanger

L’effetto flanger applicato a un suono si incrementa a ogni ripetizione dando vita a battimenti di complessità crescente.

- Elemento di elaborazione: ring modulator

Il modulatore ad anello, con modulante piazzata su uno degli armonici, espande lo spettro e ne cambia il bilanciamento a ogni ciclo di loop.

That Goodbye inizia con la voce di Dylan Thomas che passa attraverso un banco di 8 filtri passa-banda e viene suddivisa in altrettanti flussi audio indipendenti che rapidamente si sfasano.

Ognuno di essi si infila, poi, in una linea di ritardo con tempo differenziato rispetto alle altre (da circa 5 a circa 12 secondi). Le frequenze di taglio e la larghezza di banda dei filtri non sono regolarmente spaziate, ma sono state tarate sulle bande di maggiore attività del segnale e vanno da 100 a 5000 Hz.

In questa prima fase l’elemento di elaborazione nel loop è principalmente il riverbero che allunga il suono e lo trasfigura distruggendo le parole e trasformandolo in bande frequenziali di altezza differenziata. Le bande basse e medie hanno tempi di riverbero più lunghi (fino a 6-8 secondi) e formano rapidamente delle fasce sonore di sfondo in evoluzione su cui si muovono gli elementi più acuti.

Nella seconda fase utilizzo come input alcuni dei punti finali di trasformazione della prima che vengono inviati a delay con processing differenziati, soprattutto flanger, filtri, ring modulator e inviluppi. Questi ultimi due sono i responsabili dell’emergere di suoni tipo campana derivanti dalla trasformazione spettrale delle bande medio-alte e dall’applicazione di un inviluppo che all’inzio è lineare e si fonde con il resto, ma diventa più sensibile e differenziato via via che si fa maggiormente percussivo.

Verso la fine della seconda fase parte una terza fase che inizia sulle bande basse a cui si applicano delay con ring modulator e pitch shift sulla scala armonica dando vita a una scalata agli armonici che si espande ad ogni ciclo di loop.

Questa parte si risolve in una quarta e ultima fase che si muove quasi all’indietro nel pezzo mandando in loop i risultati di varie convoluzioni fra la frase originale e e frammenti tratti dalle tre fasi precedenti creando una serie di fantasmi del frammento di partenza.

Mauro Graziani – That Goodbye (2002)