Désintégrations (1983), per orchestra da camera e nastro magnetico è uno dei lavori più rappresentativi di Tristan Murail e della musica spettrale.

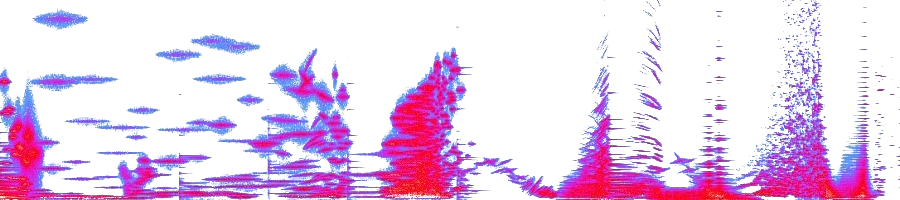

Désintégrations è stata composta dopo un lavoro approfondito sul concetto di “spettro”. Tutto il materiale del brano (sia il nastro che la partitura orchestrale), le sue microforme, i suoi sistemi d’evoluzione, deriva dalle analisi, dalle decomposizioni o dalle ricostruzioni artificiali di spettri armonici o inarmonici.

La maggior parte di questi spettri è d’origine strumentale. Suoni di bassi piano, di ottoni, di violoncello sono stati particolarmente utilizzati.

Il nastro magnetico non cerca di ricostituire suoni strumentali. Questi ultimi fungono soltanto da modelli o da materiale per la costruzione di timbri o di armonie (per me del resto c’è poca differenza tra queste due nozioni), ed anche per la costruzione di forme musicali.

Molti tipi di trattamenti degli spettri sono usati nel brano:

- Frazionamento: si utilizza soltanto una regione dello spettro (ad esempio, suoni di campana dell’inizio e della fine ottenuti con frazionamento di suoni di piano).

- Filtraggio: si evidenziano o si eliminano alcune componenti.

- Esplorazione spettrale (movimenti all’interno del suono): si ascoltano le parziali una dopo l’altra, il timbro diventa melodia (ad esempio, nella terza sezione, suoni di piccole campane che provengono dalla disintegrazione di timbri di clarinetto e flauto).

- Creazione di spettri inarmonici, “lineari” per somma o sottrazione di una frequenza (per analogia con la modulazione in anello o la modulazione di frequenza), “non lineari” con torsione di uno spettro o descrizione di una curva di frequenze (ad esempio, nella penultima sezione, torsione progressiva di un suono di trombone grave).

Il nastro è stato realizzato con sintesi additiva: si descrive in tutte le proprie dimensioni ogni componente di un suono. Questo permette di agire sugli spettri in modo estremamente preciso ed analitico e avvicinare processo di sintesi e processo di composizione, a tal punto che il nastro è stato veramente “scritto” prima di essere realizzato.

La scrittura orchestrale ha anche beneficiato della potenza dell’elaboratore, per la definizione delle altezze e delle durate ed anche per il disegno di alcune microforme. Nastro e strumenti procedono dunque dalla stessa origine e sono in relazione di complementarità. Spesso, il nastro evidenzia il carattere degli strumenti, diffrange o disintegra il loro timbro, o amplifica gli effetti orchestrali. Deve essere perfettamente sincrona, da cui la necessità di “clic” di sincronizzazione che il direttore deve seguire.

Le due fonti, strumentali e sintetiche, sono quasi sempre fuse e contribuiscono a creare momenti sonori o percorsi musicali nuovi; il discorso musicale gioca spesso sull’ambiguità tra queste due fonti, essendo lo scopo ultimo di cancellare ogni differenza fra dei mondi sonori a priori distinti.

La musica procede seguendo dei percorsi più che per sezioni distinte. Ogni momento mette l’accento su un trattamento spettrale particolare, ogni percorso fa evolvere variamente la materia musicale, tra armonicità ed inarmonicità, ombra e luce, semplicità e complessità. Contorni precisi sorgono da oggetti fluidi, l’ordine sorge da caos ritmici, i suoni evolvono incessantemente, si deformano cambiando natura…

Tristan Murail – Désintégrations (1983), per orchestra da camera e nastro magnetico