Il Conservatorio di Musica “Bonporti” di Trento, in collaborazione con la rivista di poesia Anterem di Verona, realizza un concerto di musiche nuove, in prima, su testi poetici, alcuni inediti. a Verona, domenica 16 novembre alle ore 11, alla biblioteca comunale. quindi a Riva del Garda, il 22 novembre, al conservatorio, alle 20.30. poi, nel mese di dicembre, a trento.

Suoni e Poesia e’ il titolo di questa ricerca artistica e di sperimentazione, che si tiene da diversi anni, ormai, coinvolgendo gruppi di compositori docenti del conservatorio, come di compositori invitati, ora anche un gruppo selezionato di studenti.

Un progetto di sperimentazione creativa, che riguarda insieme la musica e la poesia, anima la manifestazione “Suoni e poesia”, giunta alla terza edizione, che il Conservatorio di musica “Bonporti” di Trento e Riva del Garda organizza, in collaborazione con la rivista di poesia Anterem di Verona. Si svolge tra Verona, Riva del Garda e Trento, a partire da domenica 16 novembre, che vede il primo appuntamento, a Verona, alla Biblioteca Comunale, Spazio Nervi, alla ore 11.00. Successivamente, il 22 novembre, il concerto sarà a Riva del Garda, all’Auditorium del Conservatorio, alle ore 20.30. Quindi, replica a Trento, nel mese di dicembre, nel contesto del festival “Il Conservatorio per la città”.

Nella proposta di quest’anno, dieci composizioni di studenti compositori del “Bonporti”, che vengono rappresentate in prima esecuzione assoluta. Sono state scritte appositamente per il progetto, nel contesto dei corsi di Composizione, Musica elettronica, Nuove tecnologie e multimedialità del Conservatorio, per la cura di coordinamento dei prof.ri Massimo Priori, Nicola Straffelini, Leonardo Polato, Mauro Graziani. Le composizioni trattano altrettanti testi poetici, alcuni inediti, plasmandoli nel coinvolgimento della voce, che si ritrova nella declinazione di canto o anche in quella della recitazione. Il contesto di accompagnamento musicale è vario, coinvolge gli strumenti o anche l’elaborazione elettronica.

Gli autori delle composizioni sono Marco Banal, Nadia Carli, Antonio Casagrande, Laura Crescini, Andrea Gonella, Andrea Mattevi, Enrico Miaroma, Lucia Palaoro, Mauro Tonolli.

Le poesie, come le musiche, sono anch’esse, per lo più nuove, scelte dalla Rivista Anterem, che organizza un festival di poesia a Verona, e il noto premio “Lorenzo Montano”. Alcune opere letterarie, recentemente premiate nel XXII concorso di poesia “Lorenzo Montano” (2008) di Verona, sono state messe in musica dagli studenti compositori del Conservatorio. Accanto ad esse, poesie che sono state raccolte dalla rivista Anterem. Questi i nomi dei poeti messi in musica: Yves Bonnefoy, Silvia Bre, Mara Cini, Paolo Ferrari, Massimiliano Finazzer Flory, Philippe Jaccottet, Camillo Pennati, Michele Ranchetti, Luigi Trucillo.

Il risultato è la realizzazione di opere assai diverse fra di loro che, oltre a mostrare delle ovvie quanto naturali distinzioni stilistiche ed espressive, si pongono come una rassegna delle numerose possibilità di integrazione fra le due arti.

Studenti del Conservatorio “Bonporti” sono anche gli interpreti, solisti o in formazioni da camera, o impegnati ai dispositivi elettronici. Gli studenti hanno lavorato nel contesto degli ensemble strumentali curati dai prof.ri Simonetta Bungaro e Corrado Ruzza. Così risultano impegnati nel progetto, B. Canins e C. Molinari (flauto), F. Pola e N. Bortolamedi (clarinetto), A. Mattevi (viola), V. Rakos (violoncello), D. Cavada, I. Tibolla, A. Sala, F. Moncher (pianoforte), C. Turrini (voce recitante), I. Pisoni, F. Monatti e D. Tosi (canto), M. Banal, L. Palaoro, N. Carli e A. Gonella (dispositivi elettroacustici). La presenza video, in uno dei brani in programma, è di L. Olzer.

Conservatorio di Musica di Trento “F. A. Bonporti”

Galleria Legionari Trentini, 5

38100 Trento

Tel. 0461 261673

Fax 0461 263888

http://www.conservatorio.tn.it

Unbelievable but true!

Unbelievable but true!

.

.

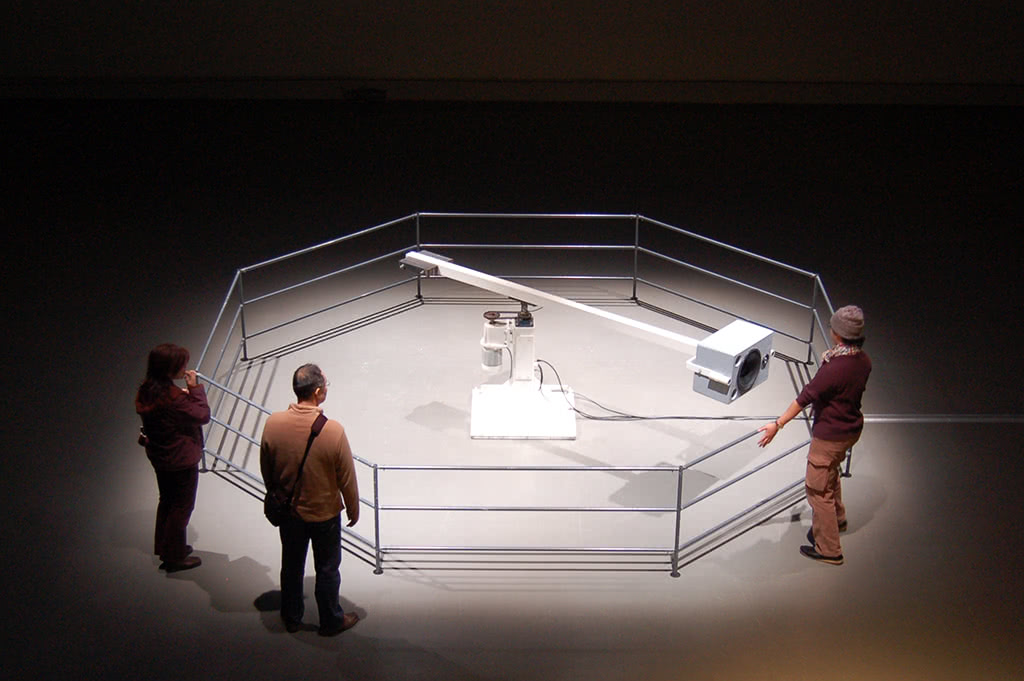

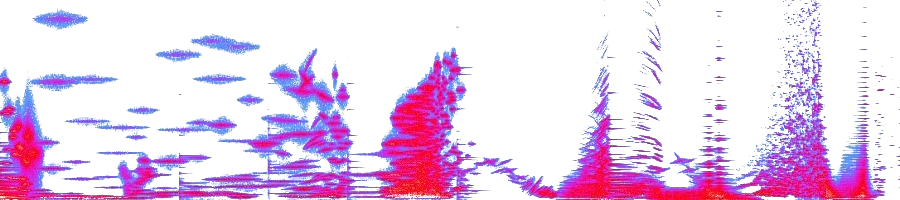

An evolving, resonating journey through splintering landscapes and mysterious characters. Abstractions and forms are reverberated in fragile soundscapes of chaotic planes and unsettling arrhythmic patterns. Is it film or an improvised VJ cut-up? Is it visualized music feeding back into images, or images generating music?

An evolving, resonating journey through splintering landscapes and mysterious characters. Abstractions and forms are reverberated in fragile soundscapes of chaotic planes and unsettling arrhythmic patterns. Is it film or an improvised VJ cut-up? Is it visualized music feeding back into images, or images generating music?  20’51” è il nuovo lavoro del compositore colombiano, trasferito a NY,

20’51” è il nuovo lavoro del compositore colombiano, trasferito a NY,

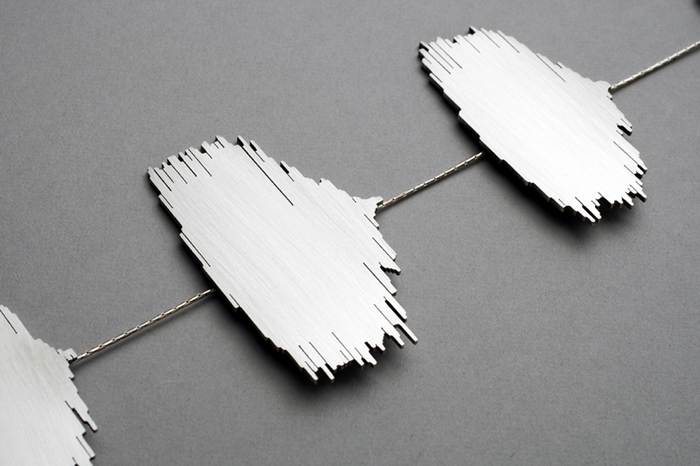

Ho sempre desiderato delle suonerie che non fossero le solite canzoncine oppure le orride rielaborazioni di brani classici che si trovano normalmente nei telefoni. Ho anche pensato di farmene qualcuna ed è solo per la mia insana pigrizia che ancora non esistono.

Ho sempre desiderato delle suonerie che non fossero le solite canzoncine oppure le orride rielaborazioni di brani classici che si trovano normalmente nei telefoni. Ho anche pensato di farmene qualcuna ed è solo per la mia insana pigrizia che ancora non esistono.

Ora, invece, veniamo al gioco “Operation Pedopriest”. Tradotto in italiano, chissà come mai, con “Operazione Pretofilia”, il gioco è una pura operazione di satira. Il comunicato di Molleindustria diceva

Ora, invece, veniamo al gioco “Operation Pedopriest”. Tradotto in italiano, chissà come mai, con “Operazione Pretofilia”, il gioco è una pura operazione di satira. Il comunicato di Molleindustria diceva

I malefici e simpaticissimi ragazzini di South Park sono originali anche sul 9/11.

I malefici e simpaticissimi ragazzini di South Park sono originali anche sul 9/11.